2018網(wǎng)站的建設(shè)與維護(hù)前景網(wǎng)店代運(yùn)營(yíng)商

文章目錄

- 前言

- 流程

- 案例操作

前言

流程

回歸問(wèn)題預(yù)測(cè)連續(xù)值,在某個(gè)區(qū)間內(nèi)變動(dòng).

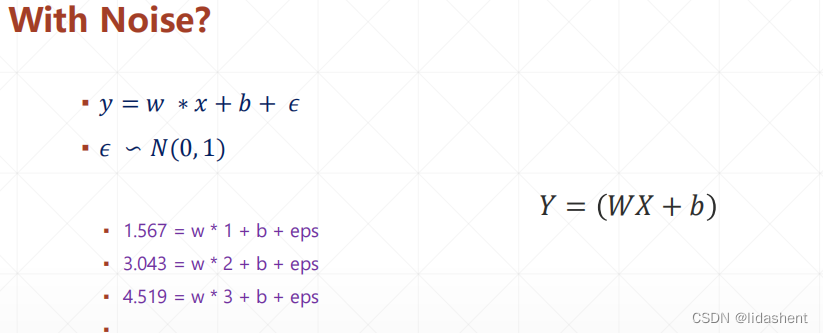

常見(jiàn)的線性回歸問(wèn)題模型是y=ax+b,然而現(xiàn)實(shí)世界由于大量的數(shù)據(jù)偏差以及復(fù)雜度,同時(shí)還有大量的噪聲,往往達(dá)不到如此的精確解,實(shí)際解決問(wèn)題時(shí)需要考慮噪聲的存在

對(duì)于噪聲,往往我們已經(jīng)假設(shè)了它符合高斯0-1分布,如果噪聲是隨機(jī)的就無(wú)法推算了

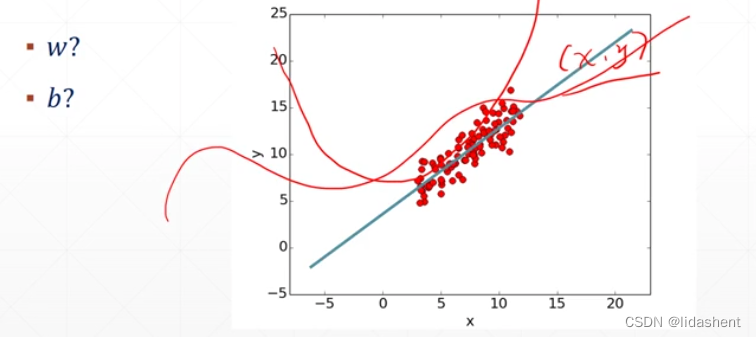

問(wèn)題在于這組數(shù)據(jù)是如何分布的

一小組數(shù)據(jù)在某個(gè)區(qū)間內(nèi)的函數(shù)圖像究竟是如何?

如何去求解wb?來(lái)自主優(yōu)化其數(shù)據(jù)迭代?

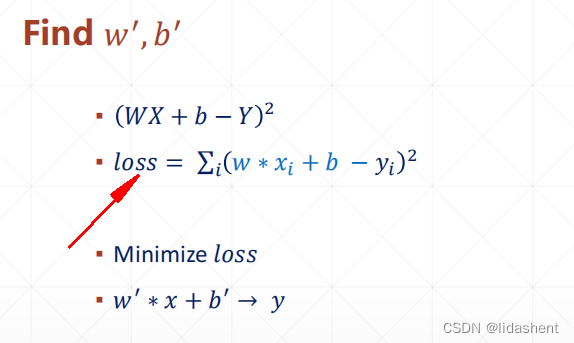

在此之前設(shè)定一個(gè)評(píng)價(jià)函數(shù)

預(yù)測(cè)值和真實(shí)值得平方和越來(lái)越小時(shí),loss函數(shù)將起作用

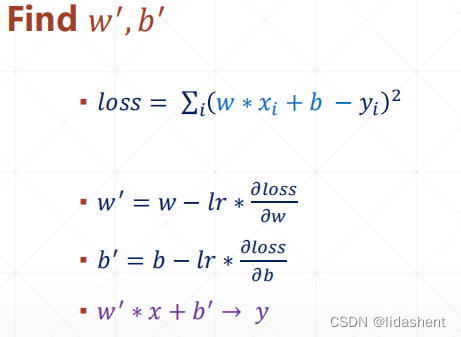

問(wèn)題是如何自動(dòng)更新合適的w和b來(lái)達(dá)到這個(gè)效果?

要確保w和b快速收斂,準(zhǔn)確的沿?cái)?shù)據(jù)的變化走向進(jìn)行預(yù)測(cè),loss越小越準(zhǔn)

準(zhǔn)確的說(shuō)w和b沿著loss函數(shù)下降的方向前進(jìn)

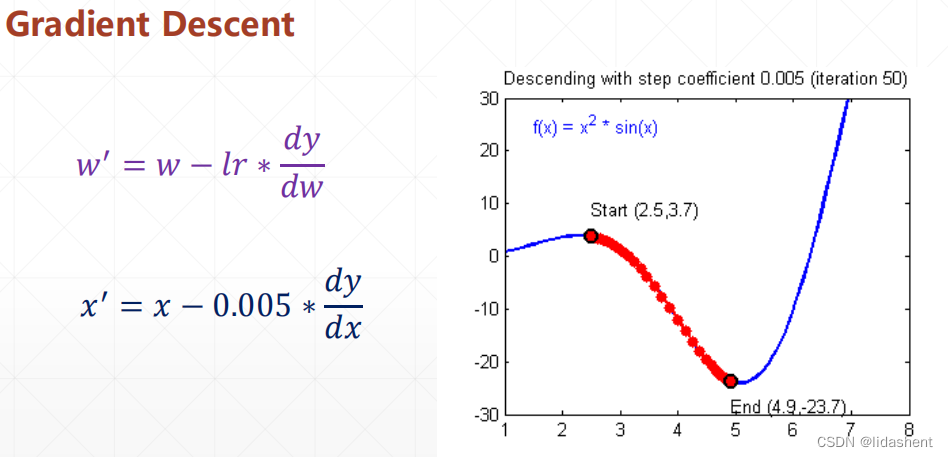

lr代表步長(zhǎng),這個(gè)需要合適設(shè)置避免進(jìn)入相對(duì)最小值

衰減因子則代表著沿著增大的導(dǎo)數(shù)的反方向前進(jìn),如果導(dǎo)數(shù)為正,則是圖像是數(shù)據(jù)增大方向,則x變小尋找山谷,如果導(dǎo)數(shù)為負(fù),則圖像數(shù)據(jù)減小方向,則x增大,尋找山谷如是

(數(shù)據(jù)圖像,導(dǎo)數(shù)圖像,對(duì)導(dǎo)數(shù)的變化求最小值的方向)

比如當(dāng)前位置3.2,導(dǎo)數(shù)-23.3 則,位移變化方向是 3.3165

x=3.2-(-23.3*0.005) x2=x-△w

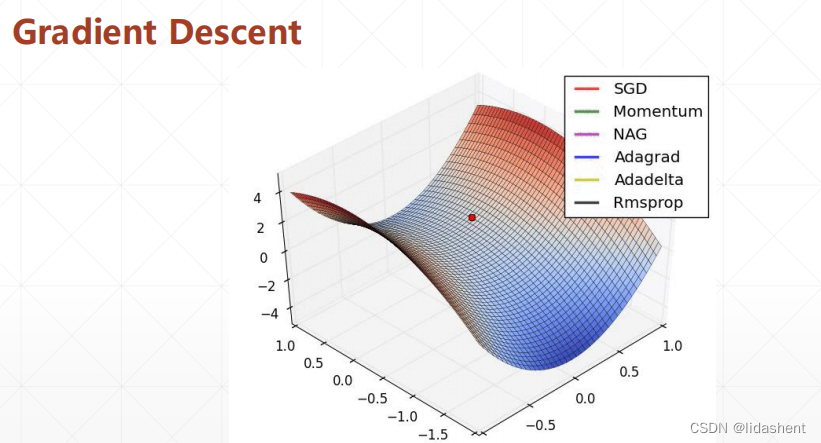

這只是w的一種情況,然后看b,二維向量圖,從隨機(jī)點(diǎn)開(kāi)始進(jìn)行梯度下降

三個(gè)軸分別代表了w,b和z軸loss,

公式為

運(yùn)行后會(huì)自動(dòng)找到合適的wb對(duì)數(shù)據(jù)進(jìn)行公式建模

預(yù)測(cè)值和真實(shí)值之間的平方差成為了loss函數(shù),這樣將求解最佳wb的問(wèn)題變成了求解最小loss的問(wèn)題

然后loss代表梯度,w和b向著梯度減小的方向前進(jìn),每次梯度變化可能非常大,因此需要進(jìn)行步伐控制

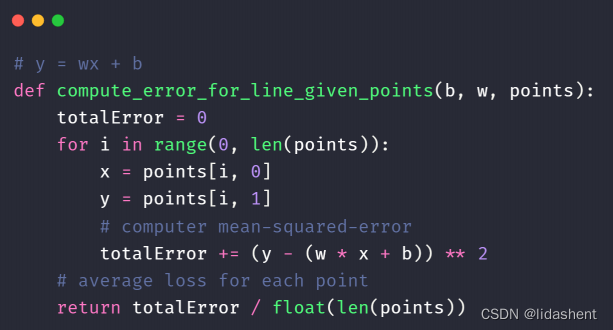

δloss代表平均值loss.總loss/len樣本數(shù)量

因此計(jì)算loss代碼為

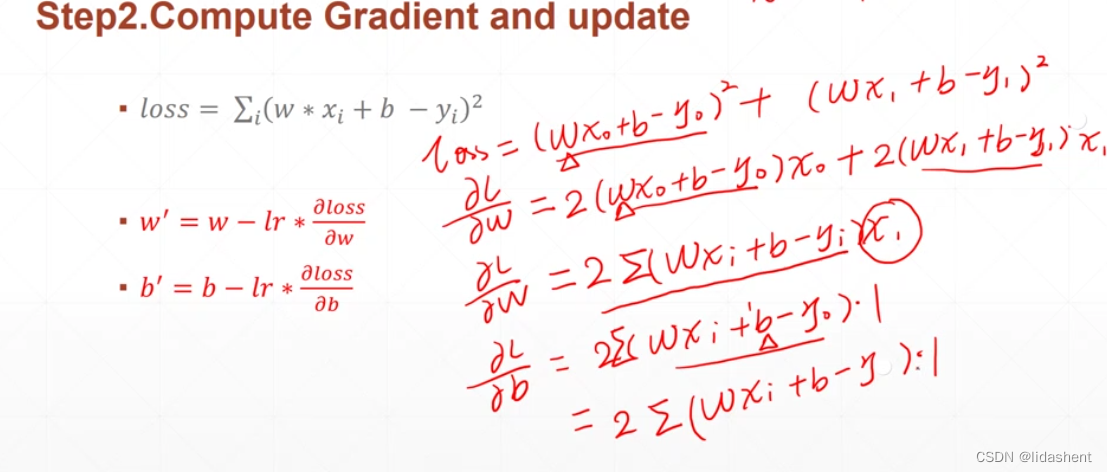

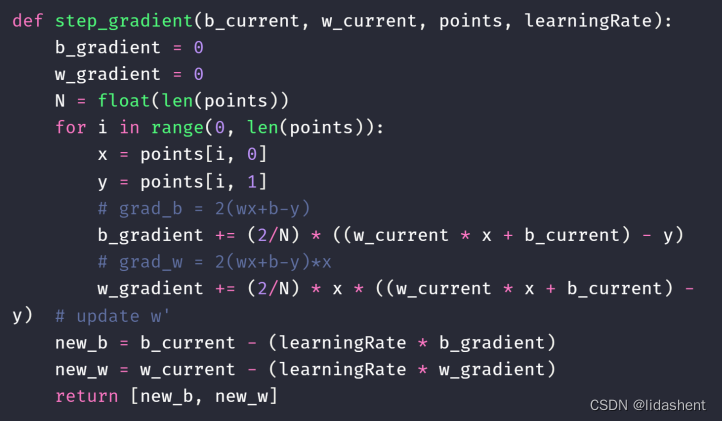

數(shù)學(xué)原理

x^2求導(dǎo)得到2x,所以δloss/δw=2xxxxx +2xxxxx…

b導(dǎo)數(shù)為1,因此…

根據(jù)loss對(duì)w和b的導(dǎo)數(shù),確定那里是梯度下降的方向,對(duì)w和b進(jìn)行更新,變相的求loss下降的方向

代碼實(shí)現(xiàn)為:

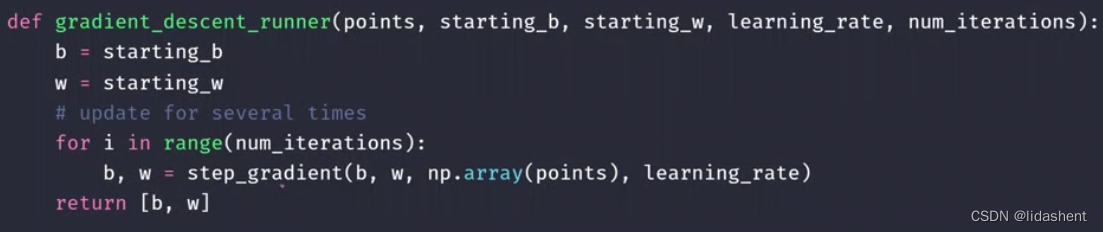

然后不斷迭代就得到了應(yīng)有的w和b權(quán)重

基于線性模型建立的有如下三種

線性模型

二分類模型(sigmod函數(shù)用于劃分01)

多分類模型

案例操作

使用numpy實(shí)現(xiàn)與tensorflow對(duì)比實(shí)現(xiàn)兩者

tensorflow2.4運(yùn)行即可,帶數(shù)據(jù)與代碼

https://www.aliyundrive.com/s/LmAms9tzWdq